Исследователи из Университета Кембриджа и Корнельского университета обнаружили, как построить надежные модели машинного обучения, способные понимать сложные уравнения в реальных ситуациях, используя гораздо меньше обучающих данных, чем это обычно требуется.

Согласно результатам исследования, опубликованным в Proceedings of the National Academy of Sciences, для частичных дифференциальных уравнений – класса физических уравнений, описывающих эволюцию объектов в природе в пространстве и времени – модели машинного обучения могут давать надежные результаты, даже если им предоставляют ограниченное количество данных.

Эти результаты могут быть полезными для создания более време- и затратоэффективных моделей машинного обучения в таких областях, как инженерия и климатическое моделирование.

Традиционно большинство моделей машинного обучения требует большого объема обучающих данных, прежде чем они начинают возвращать точные результаты. Обычно человек размечает большой объем данных, например, набор изображений, чтобы обучить модель.

Научный сотрудник из Института математических наук имени Исаака Ньютона, доктор Николя Булле, вместе с коллегами из Корнелльского университета, Дианой Халикиас и Алексом Таунсендом, исследуют, насколько мало данных необходимо для обучения моделей машинного обучения, чтобы получить надежные результаты.

По словам доктора Булле: “Использование людей для обучения моделей машинного обучения эффективно, но также затратно и времязатратно. Нас интересует, насколько мало данных нам действительно нужно, чтобы обучить эти модели и все равно получить надежные результаты”.

В отличие от других исследователей, которые обучали модели машинного обучения на небольшом объеме данных и достигали отличных результатов, исследователи сосредотачиваются на уравнениях в частных производных (УЧП).

“УЧП – это своего рода строительные блоки физики: они могут помочь объяснить физические законы природы, такие как то, как удерживается устойчивое состояние в плавящемся блоке льда”, – сказал доктор Булле.

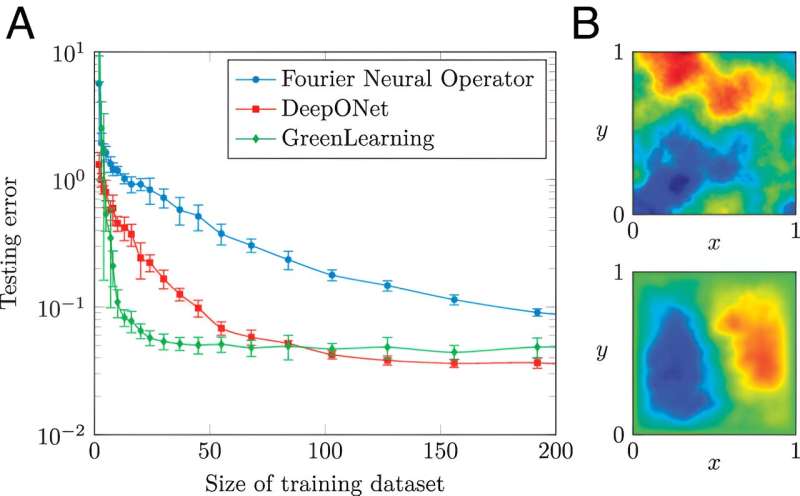

Исследователи обнаружили, что УЧП, описывающие диффузию, имеют структуру, которая полезна для проектирования моделей искусственного интеллекта. Они разработали эффективный алгоритм для прогнозирования решений УЧП в различных условиях, используя короткодействующие и долгодействующие взаимодействия. Это позволило им внедрить математические гарантии в модель и определить точное количество данных, необходимых для создания надежной модели.

“Это зависит от области, но для физики мы обнаружили, что вы можете добиться многого с очень ограниченным объемом данных”, – сказал доктор Булле. “Удивительно, как мало данных вам нужно, чтобы получить надежную модель. Благодаря математике этих уравнений, мы можем использовать их структуру, чтобы сделать модели более эффективными”.

Исследователи считают, что их методы позволят ученым по данным раскрывать “черный ящик” многих моделей машинного обучения и создавать новые модели, которые могут быть интерпретированы людьми, хотя для этого понадобится дополнительное исследование.

“Нам нужно убедиться, что модели учатся правильным вещам, но машинное обучение для физики – это увлекательная область, в которой есть много интересных математических и физических вопросов, на которые ИИ может нам помочь ответить”, – заключил доктор Булле.

/cloudfront-us-east-2.images.arcpublishing.com/reuters/LAZP2UYTONLL3NMMSYUQFS6E5U.jpg)