Быстрое развитие технологий искусственного интеллекта (ИИ), возможно, привело к революционным изменениям в различных отраслях, но оно также породило новые проблемы в области безопасности и регулирования.

Испытания

Во-первых, с точки зрения безопасности и конфиденциальности данных модели искусственного интеллекта часто требуют большого количества личных, конфиденциальных данных для обучения и работы, что значительно увеличивает риск утечки данных и нарушения конфиденциальности. Например, в таких областях приложений, как распознавание лиц, распознавание голоса и интеллектуальный анализ данных, особенно важны вопросы безопасности данных и защиты конфиденциальности.

Во-вторых, все большее внимание привлекают проблемы этической и социальной предвзятости в моделях ИИ. Если данные обучения содержат предвзятости, модели ИИ, скорее всего, унаследуют и усилит эти предвзятости, что приведет к несправедливым или даже дискриминационным решениям при применении. Кроме того, многие передовые модели искусственного интеллекта, такие как модели глубокого обучения, действуют как модели «черного ящика» и им не хватает прозрачности и объяснительности в процессе принятия решений, что может иметь серьезные последствия в таких важных областях, как здравоохранение, судебная система и финансы.

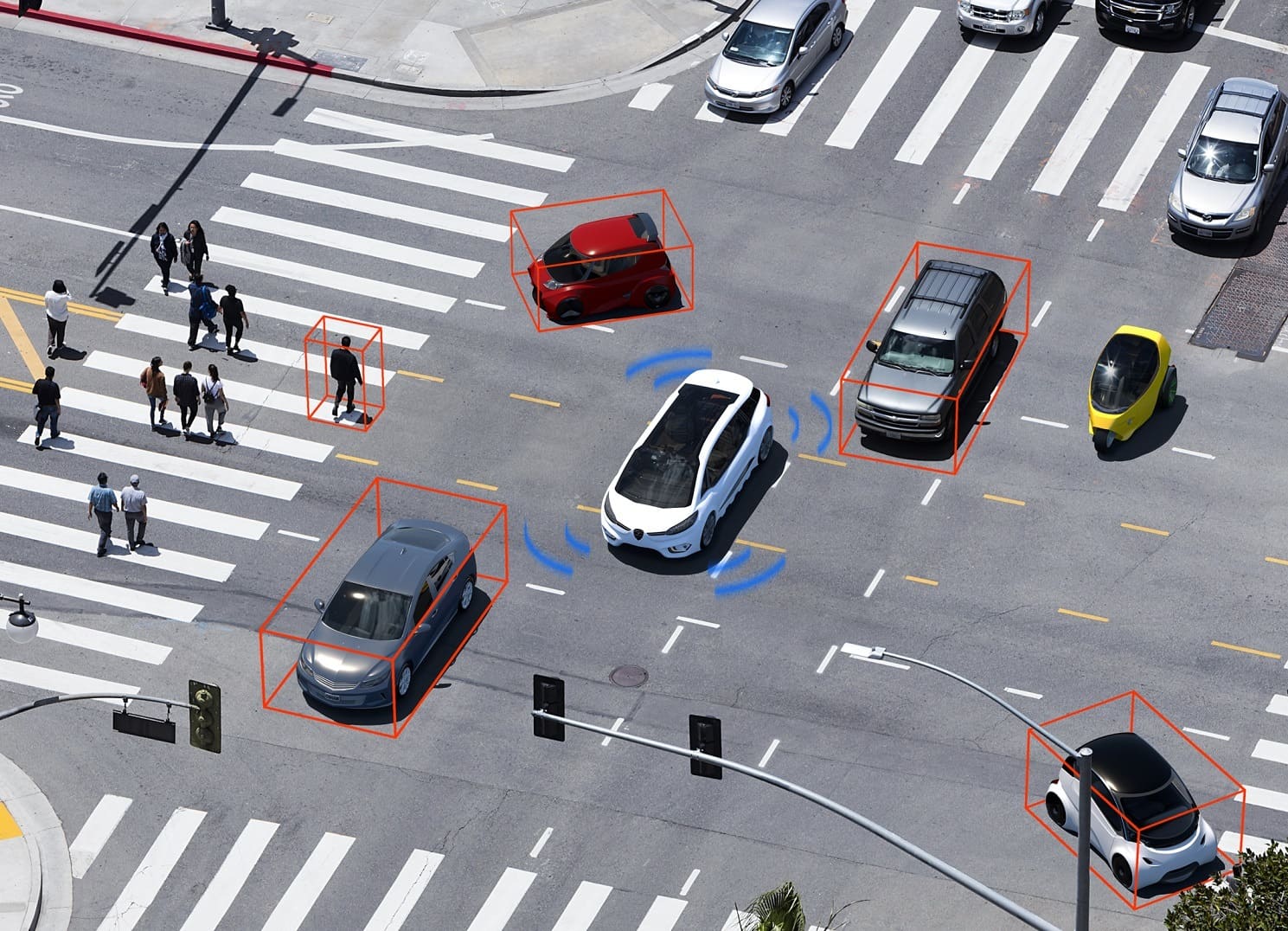

Кроме того, начали появляться новые типы состязательных атак. Эти атаки могут ввести в заблуждение модели ИИ, внося незначительные изменения во входные данные, что приводит к получению неверных или потенциально опасных результатов. Это не только представляет угрозу для отдельных пользователей, но также может повлиять на общую безопасность общества.

Поскольку технология искусственного интеллекта становится все более популярной в создании контента, автономном вождении, медицинской диагностике и других областях, юридические вопросы и вопросы соответствия становятся все более важными. В настоящее время во всем мире отсутствует единая нормативно-правовая база в области ИИ, что усложняет транснациональным компаниям и исследовательским институтам решение вопросов соответствия.

Будучи одной из стран с самым быстрым развитием технологий искусственного интеллекта, Китай уделяет первоочередное внимание регулированию безопасности искусственного интеллекта.

Управление в развивающейся области

Страны по всему миру постепенно начали разрабатывать и внедрять положения и правила в области ИИ. Например, в США регулирование ИИ в основном осуществляется как на федеральном уровне, так и на уровне штатов. Федеральное правительство в основном осуществляет регулирование через специализированные агентства, такие как Федеральная торговая комиссия (FTC) и Национальный институт стандартов и технологий (NIST), уделяя особое внимание вопросам безопасности данных, конфиденциальности и этики.

В январе 2023 года NIST выпустил структуру управления рисками искусственного интеллекта (AI RMF 1.0), призванную помочь организациям снизить риски безопасности, избежать предвзятости и других негативных последствий, а также повысить доверие к системам искусственного интеллекта при их разработке и развертывании.

Европейский Союз (ЕС), с другой стороны, уделяет больше внимания этике и защите конфиденциальности ИИ, типичным примером является Общий регламент по защите данных (GDPR). Кроме того, ЕС выпустил серию этических руководств по искусственному интеллекту и планирует в ближайшие годы ввести комплексную нормативную базу в области искусственного интеллекта.

В Азии Япония и Южная Корея уделяют больше внимания техническим стандартам и этическим принципам, а Сингапур стремится привлечь международные компании в области искусственного интеллекта с помощью гибких мер регулирования. Будучи одной из стран с самым быстрым развитием технологий искусственного интеллекта, Китай уделяет первоочередное внимание регулированию безопасности искусственного интеллекта. За последний год или около того Китай последовательно ввел ряд мер регулирования, направленных на ИИ.

Это первый случай, когда Китай сделал четкие положения для исследований, разработок и услуг генеративного искусственного интеллекта.

Успехи Китая в регулировании ИИ

1 марта 2022 года Китай представил свой первый общенациональный специализированный нормативный акт в отношении ИИ — «Положения об администрировании генерируемых алгоритмами рекомендаций для информационных интернет-услуг», который стандартизирует использование технологий рекомендаций по алгоритмам при предоставлении онлайн-услуг на территории Китая.

25 ноября 2022 года Китай опубликовал Положения об администрировании глубокого синтеза в информационных службах Интернета, которые предусматривают, что поставщики и технические поставщики услуг глубокого синтеза должны информировать и получать отдельное согласие от лиц, чья биометрическая информация, такая как лица и голоса, является редактируется.

В частности, 13 июля 2023 года семь национальных ведомств, включая Администрацию киберпространства Китая, совместно объявили о временных мерах по управлению службами генеративного искусственного интеллекта (далее именуемые «Меры»). Меры официально вступили в силу 15 августа 2023 года и направлены на регулирование более широкого спектра технологий генеративного искусственного интеллекта. Это первый случай, когда Китай сделал четкие положения для исследований, разработок и услуг генеративного искусственного интеллекта.

Меры позитивно относятся к услугам генеративного ИИ, неоднократно упоминая поощрение инновационных применений технологий генеративного ИИ в различных отраслях и областях. Они стремятся создавать позитивный, здоровый и воодушевляющий высококачественный контент; изучить оптимизированные сценарии применения; и построить экосистему приложений.

Кроме того, эти меры поощряют независимые инновации в основополагающих технологиях, таких как генеративные алгоритмы искусственного интеллекта, платформы, чипы и вспомогательные программные платформы. Они также способствуют равноправным и взаимовыгодным международным обменам, сотрудничеству и участию в разработке международных правил, касающихся генеративного ИИ.

Посредством классификации и классификации можно применять более целенаправленные меры регулирования к различным типам приложений AIGC…

Меры

Среди них три аспекта этих мер заслуживают особого внимания.

Классификация и ранжирование приложений

Во-первых, в нем подчеркивается механизм классификации и классификации служб генеративного искусственного интеллекта (AIGC), подчеркивая важный подход к последующим механизмам регулирования, нацеленным на различные типы рисков. Посредством классификации и классификации к различным типам приложений AIGC можно применять более целенаправленные меры регулирования, тем самым обеспечивая эффективность и специфичность регулирования.

Укрепление отраслевой экосистемы

Во-вторых, меры управления направлены на развитие отраслевой экосистемы AIGC, особенно в отношении создания генеративной инфраструктуры искусственного интеллекта и общедоступных платформ ресурсов для обучения. В нем подчеркивается содействие совместному использованию вычислительных ресурсов для повышения эффективности их использования.

Содействуя упорядоченному открытию классифицированных и классифицированных общедоступных данных, расширяя высококачественные ресурсы общедоступных обучающих данных и поощряя использование безопасных и надежных чипов, программного обеспечения, инструментов и вычислительных ресурсов, можно обеспечить более стабильную и надежную инфраструктурную поддержку для развитие отрасли AIGC.

Внутренние и международные обмены и сотрудничество

В-третьих, меры управления подчеркивают внутренние и международные обмены и сотрудничество. Они дифференцируют сферу применения в зависимости от услуг, предоставляемых внутри страны и за рубежом, а также видов бизнеса, которые не предоставляют услуги внутри страны, уточняя сферу регулирования.

Для иностранных инвестиций в генеративные услуги искусственного интеллекта требуется соблюдение соответствующих законов и административных правил об иностранных инвестициях. Укрепление международного сотрудничества и обменов может способствовать более эффективному внедрению передовых технологий и услуг из-за границы, а также более эффективному продвижению китайской отрасли AIGC на международный рынок.

Защита несовершеннолетних и других лиц

Кроме того, в этих мерах уделяется большое внимание защите несовершеннолетних, требуя эффективных мер по предотвращению чрезмерной зависимости или зависимости от генеративных услуг искусственного интеллекта у несовершеннолетних пользователей.

Что касается надзора за генеративным ИИ, в Мерах также упоминается, что соответствующие органы могут осуществлять надзор и проверку услуг генеративного ИИ в соответствии со своими обязанностями. Поставщики услуг должны сотрудничать и предоставлять подробные объяснения по мере необходимости относительно источника, масштаба, типа, правил аннотации и алгоритмических механизмов обучающих данных, а также предлагать необходимую техническую поддержку и поддержку данных.

Кроме того, меры охватывают множество аспектов защиты, таких как неприкосновенность частной жизни и коммерческая тайна. Например, организации и персонал, участвующие в оценке безопасности и надзоре за услугами генеративного ИИ, должны сохранять конфиденциальность любых государственных секретов, коммерческих тайн, личной тайны и личной информации, которые им становятся известны в ходе выполнения своих обязанностей, и не должны раскрывать или незаконно предоставлять их другим.

Регулирование ИИ все еще находится на зачаточном этапе, и основная задача заключается в том, как найти баланс между технологическими инновациями, этикой и безопасностью.

Баланс между регулированием ИИ и развитием ИИ

В целом, меры направлены на предотвращение рисков, а также включают в себя определенные механизмы отказоустойчивости и исправления ошибок, повышая осуществимость реализации и более эффективно достигая динамического баланса между регулированием ИИ и развитием технологий ИИ. Это дает ценную информацию другим странам при разработке положений по безопасности и регулированию, касающихся ИИ.

Таким образом, в авангарде области ИИ находятся такие страны и регионы, как Северная Америка, Европа и азиатские страны, включая Китай, Японию, Южную Корею и Сингапур, которые быстро разрабатывают и совершенствуют системы регулирования ИИ. Однако для многих развивающихся стран регулирование ИИ все еще находится на зачаточной стадии, и основная проблема заключается в том, как найти баланс между технологическими инновациями, этикой и безопасностью. Некоторые страны начали формулировать базовые стратегии и политику в области ИИ, но большинству из них еще предстоит создать всеобъемлющую нормативную базу.

Помимо внутренних мер регулирования, международные организации, такие как Организация Объединенных Наций, Всемирный экономический форум и Организация экономического сотрудничества и развития, также должны активно продвигать глобальное сотрудничество в регулировании ИИ. Эти организации в первую очередь фокусируются на влиянии ИИ на глобальную экономику, общество и безопасность и стремятся создать справедливую, прозрачную и устойчивую глобальную экосистему ИИ.

В будущем правила, регулирующие ИИ во всем мире, будут продолжать развиваться и совершенствоваться, чтобы адаптироваться к быстрому развитию и глобальному применению технологий ИИ. В то же время процесс регулирования должен сбалансировать множество аспектов, таких как технологические инновации, защита конфиденциальности, этика и социальная ответственность, чтобы обеспечить устойчивое развитие и применение технологий искусственного интеллекта.

По теме: Китайские хакерские группы: обеспечение кибербезопасности критической инфраструктуры | Успехи Китая в области искусственного интеллекта: многообещающе, но не без проблем | Как Китай ужесточает контроль за трансграничной передачей данных

Читать полную новость на сайте

/cloudfront-us-east-2.images.arcpublishing.com/reuters/2M2GGSVMLJI7DNV4VFVA4LRBQM.jpg)

/cloudfront-us-east-2.images.arcpublishing.com/reuters/S73LMHDNV5KKLDC5ZCPR45AOX4.jpg)

/cloudfront-us-east-2.images.arcpublishing.com/reuters/ATYPQN5I4VP2NNBWZUDSFQ5TD4.jpg)